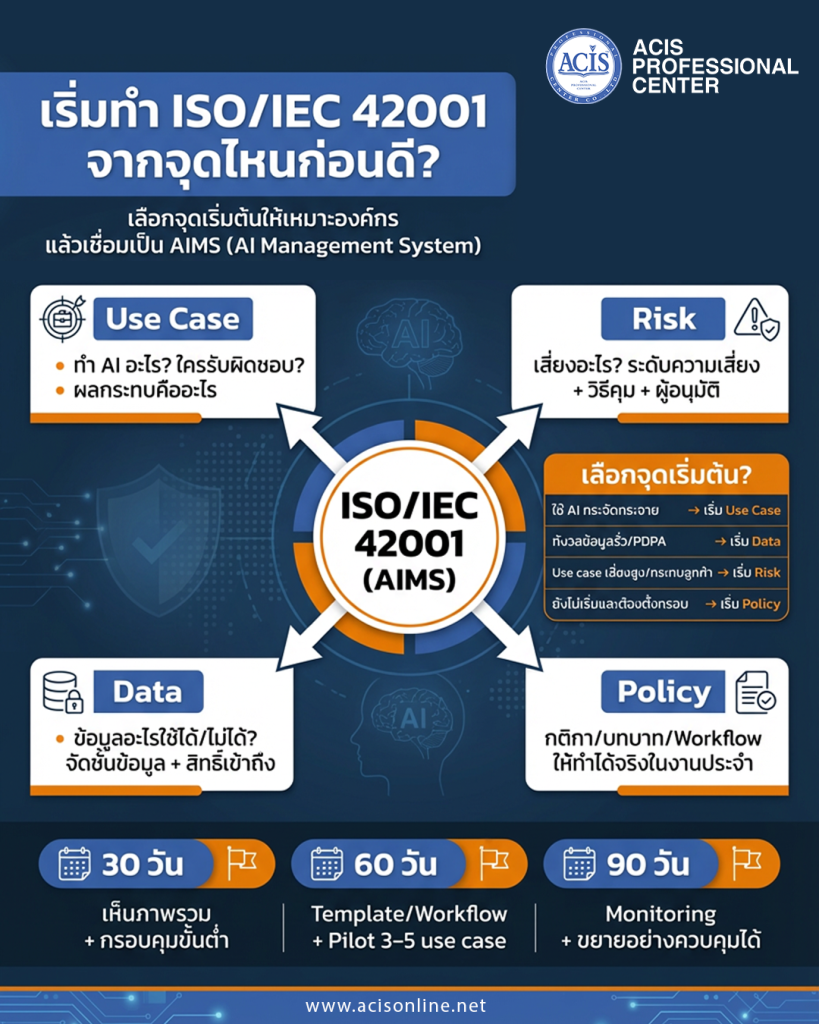

เริ่มทำ ISO/IEC 42001 จากจุดไหนก่อนดี: Use Case / Data / Risk / Policy?

ISO/IEC 42001 คือมาตรฐานสำหรับ AI Management System (AIMS) หรือ “ระบบบริหารจัดการ AI” ขององค์กร หลายทีมติดตรงคำถามเดียวกัน:

ควรเริ่มจากอะไรก่อน—Use Case, Data, Risk หรือ Policy?

คำตอบที่ใช้ได้จริงคือ: ไม่มีทางเดียว แต่มี “ทางที่เหมาะกับบริบท” และมีลำดับที่ช่วยให้เริ่มได้เร็วโดยไม่หลุดเสี่ยง

บทความนี้ให้ “แผนเริ่มต้น” แบบลงมือทำได้ พร้อมทางเลือกตามสภาพองค์กร

หลักคิดก่อนเริ่ม: ISO/IEC 42001 ต้องการ “ระบบ” ไม่ใช่ “เอกสาร”

องค์กรจำนวนมากเริ่มจากเขียน Policy ก่อน แล้วพบว่า…

- ทีมงานอ่านแต่ไม่ใช้

- Use case กระจัดกระจาย

- วัดความเสี่ยงไม่ได้

- หลักฐานตรวจสอบ (audit evidence) ไม่ครบ

ทางที่เวิร์กกว่าคือ ทำให้ 4 องค์ประกอบนี้ เชื่อมกันเป็นระบบเดียว:

- Use Case: จะใช้ AI ทำอะไร เพื่ออะไร ใครรับผิดชอบ

- Data: ใช้ข้อมูลอะไร ระดับความลับ/สิทธิ์/คุณภาพพร้อมไหม

- Risk: เสี่ยงอะไร คุมด้วยมาตรการอะไร และใครอนุมัติ

- Policy: กติกาและบทบาทที่ทำให้ทั้งหมด “ทำได้จริงในงานประจำ”

เริ่มจากจุดไหนก่อนดี? ใช้ “Decision Guide” นี้

1) ถ้าองค์กร “เริ่มใช้ AI แล้ว แต่ใช้กันเองกระจัดกระจาย” → เริ่มที่ Use Case

สัญญาณ

- หลายทีมใช้ GenAI/เครื่องมือคนละแบบ

- ไม่รู้ว่า AI ถูกใช้ทำอะไรบ้าง

- เริ่มมีคำถามจาก Security/Compliance

เริ่มที่ Use Case เพราะ

- ทำให้ “มองเห็นภาพรวม” และจัดลำดับความสำคัญได้เร็ว

- เป็นฐานให้ Risk/Policy ไม่ลอย

สิ่งที่ทำทันที (Quick wins)

- ทำ Use Case Register (รายชื่อ use case ทั้งหมด) ระบุ:

- วัตถุประสงค์/เจ้าของงาน/ผู้ใช้/ระบบที่เกี่ยวข้อง

- ข้อมูลที่ใช้ (ชนิดข้อมูล/แหล่งข้อมูล/ความลับ)

- ใครเป็นผู้อนุมัติ และระดับความเสี่ยงเบื้องต้น

- เลือก “Top 3–5 use case” ที่มี impact สูงและทำได้เร็ว

ทำ Use Case Register ให้เสร็จ = คุณเริ่ม ISO/IEC 42001 แบบจับต้องได้แล้ว

2) ถ้าองค์กร “กังวลข้อมูลรั่ว/PDPA/ข้อมูลลูกค้า” → เริ่มที่ Data

สัญญาณ

- ทีมอยากใช้ GenAI กับเอกสารจริง/เคสลูกค้าจริง

- ผู้บริหารถามเรื่อง “ข้อมูลจะรั่วไหม”

- มีระบบข้อมูลภายในเยอะ แต่ไม่มีการจัดชั้น/สิทธิ์ชัด

เริ่มที่ Data เพราะ

- ความเสี่ยงใหญ่สุดของ GenAI มักเริ่มจาก “ข้อมูล”

- ถ้าข้อมูลไม่พร้อม Use Case ก็ไปต่อยาก

สิ่งที่ทำทันที

- ทำ Data Classification แบบง่าย 3–4 ระดับ (Public/Internal/Confidential/Restricted)

- ทำ Data Access Rules: ใครใช้ข้อมูลอะไรได้ใน use case ไหน

- ตั้งแนวทาง “ห้ามใส่ PII/ข้อมูลลับลง prompt” + วิธีใช้ placeholder

- ถ้าจะใช้ knowledge base/RAG: กำหนด “Approved sources” ก่อน

3) ถ้าองค์กร “มี use case ที่เสี่ยงสูง/เกี่ยวกับการตัดสินใจ” → เริ่มที่ Risk

สัญญาณ

- AI ใช้คัดกรอง/อนุมัติ/ให้คะแนน/แนะนำสิ่งที่กระทบลูกค้า

- กลัว hallucination, bias, ความไม่โปร่งใส

- ต้องเตรียมพร้อมรับการตรวจสอบ/คู่ค้าถามหนัก

เริ่มที่ Risk เพราะ

- ผู้บริหารและฝ่ายกำกับดูแล “ตัดสินใจจากความเสี่ยง”

- ทำให้เลือก control ที่เหมาะสมและไม่โอเวอร์คุม

สิ่งที่ทำทันที

- ทำ AI Risk Assessment Template (แบบสั้นก่อน) ครอบคลุม:

- ความเสี่ยงข้อมูล (PII/ความลับ)

- ความถูกต้อง (hallucination/error)

- fairness/bias

- ความโปร่งใส/การอธิบายได้

- vendor/model risk

- incident response

- ทำ Risk Tiering 3 ระดับ (Low/Medium/High) แล้วผูกกับ workflow:

- Low: ใช้ได้ เก็บ log

- Medium: ต้อง review ก่อนส่งลูกค้า

- High: ต้องอนุมัติหลายฝ่าย + monitoring เข้ม

4) ถ้าองค์กร “ยังไม่เริ่มเลย และอยากวางกรอบให้ชัดก่อน” → เริ่มที่ Policy (แต่ต้องเป็น Policy ที่ใช้งานได้)

สัญญาณ

- องค์กรยังไม่อนุญาตให้ใช้ AI อย่างเป็นทางการ

- ต้องการกรอบเพื่อ “เปิดให้ใช้” อย่างปลอดภัย

- ต้องให้ทุกฝ่ายเข้าใจร่วมกัน

เริ่มที่ Policy ได้ แต่ต้องหลีกเลี่ยงการเขียนกว้าง ๆ แบบไม่ผูกกับงานจริง

Policy ที่ดีควรมี

- นิยามขอบเขต: AI ที่องค์กรใช้/ไม่ใช้

- บทบาทและความรับผิดชอบ (RACI)

- ข้อมูลที่ห้ามใช้/เงื่อนไขการใช้ข้อมูล

- หลักการ risk-based control (risk tier + approval)

- การเก็บ log/audit และ incident response

- แนวทาง vendor/third-party AI

เคล็ดลับ: “Policy ต้องผูกกับ Use Case Register + Risk Tiering” ไม่งั้นจะกลายเป็นเอกสารลอย

ลำดับเริ่มต้นที่แนะนำ (ส่วนใหญ่ทำแล้วเวิร์ก)

ถ้าให้เลือก “ค่าเริ่มต้น” สำหรับองค์กรทั่วไป:

Use Case → Risk → Policy → Data (Deepen) → Controls/Monitoring

เหตุผล:

- Use Case ทำให้รู้ว่าจะคุมอะไร

- Risk ทำให้รู้ว่าต้องคุมแค่ไหน (ไม่มากไป ไม่น้อยไป)

- Policy ทำให้ทุกคนทำตามได้

- Data ลงลึกเพื่อทำให้ scale ได้อย่างปลอดภัย

แต่ถ้าองค์กรคุณ “กังวลเรื่องข้อมูลมากสุด” ให้สลับเป็น:

Data → Use Case → Risk → Policy

Roadmap 30–60–90 วัน (เริ่มแบบเร็ว แต่ไม่หลุดมาตรฐาน)

0–30 วัน: “เห็นภาพรวม + คุมความเสี่ยงพื้นฐาน”

- Use Case Register (ครบอย่างน้อย 80%)

- Data classification เบื้องต้น + ข้อห้ามเรื่อง PII/prompt

- Risk tiering + workflow review สำหรับงานลูกค้าเห็น

- เริ่มเก็บ log การใช้งาน (อย่างน้อยระดับระบบ/ทีม)

ผลลัพธ์ที่ควรได้: ภาพรวม + มีกรอบคุมขั้นต่ำ + เริ่มมี evidence

31–60 วัน: “ทำให้เป็นระบบและใช้งานจริง”

- Policy ที่ผูกกับ use case และ risk tier

- Template: risk assessment, approval form, checklist output

- ตั้ง owner/committee หรือ AI governance working group

- Pilot กับ 3–5 use case ที่ impact สูง

ผลลัพธ์ที่ควรได้: ทีมทำงานตาม flow เดียวกัน เริ่ม audit-friendly

61–90 วัน: “ขยาย + เฝ้าระวัง + ปรับปรุง”

- Monitoring/KPI: quality, incident, adoption

- ปรับ controls เช่น prompt/output governance, knowledge sources

- ทบทวนผล pilot และแผน scale

ผลลัพธ์ที่ควรได้: พร้อมขยายแบบควบคุมได้ และพร้อมรับการตรวจประเมินมากขึ้น

Artifacts ที่ควรมี (เริ่มทำ ISO/IEC 42001 ให้จับต้องได้)

เริ่มจาก “ชุดเล็กแต่ครบแกน” แล้วค่อยขยาย

Incident Response for AI

Use Case Register

Data Classification & Handling Rules

AI Risk Assessment + Risk Tiering

AI Policy (ผูกกับ workflow จริง)

Approval Workflow + Human Review Rules

Logging/Audit Plan